В этом руководстве рассматриваются основные API-интерфейсы парсинга веб-страниц, оптимизированные для проектов машинного обучения и искусственного интеллекта, оценивается их точность данных, возможности антиблокировки и характеристики обработки в реальном времени. Независимо от того, обучаете ли вы модели компьютерного зрения, системы обработки естественного языка или инструменты прогнозной аналитики, эти API автоматически обрабатывают прокси, капчи и рендеринг JavaScript, предоставляя при этом четко отформатированные данные.

Мы сравнили цену, показатели успеха и уникальные функции, такие как извлечение данных на основе искусственного интеллекта, чтобы помочь вам выбрать наиболее подходящее решение для вашего процесса машинного обучения.

1. Bright Data

Brightdata предоставляет API-интерфейс веб-сканера, который можно использовать для получения данных из более чем 120 доменных имен. Извлечение структурированных веб-данных станет очень простым благодаря API веб-сканера. Brightdata отличается высокой надежностью и на 100 % соответствует законам, касающимся данных и веб-скрапинга. При использовании Brightdata вы можете выполнять сканирование по требованию через API или использовать сканер без кода. Кроме того, вам не нужно беспокоиться о недоставленных результатах, поскольку вы платите только за фактически доставленные результаты. Все процессы сбора данных

К счастью, вы можете собирать данные с различных платформ и отраслей, таких как LinkedIn, бизнес, финансы, электронная коммерция, Amazon, Instagram, Crunchbase, Zillow Real Estate, X, Facebook, Indeed, YouTube, Glassdoor, недвижимость и социальные сети. Используя API веб-сканера, вы получаете беспрецедентную стабильность при сборе необходимых вам данных. С помощью этих сканеров вы можете сэкономить ресурсы, сократить объем обслуживания, удовлетворить свои потребности в данных и поддерживать оптимальную производительность. API веб-сканера

особенность

Цена

2. Decodo

Decodo можно использовать для извлечения данных из широкого спектра доменов, включая Amazon, Amazon Sellers, метаданные YouTube, Википедию, TripAdvisor, Just Dial, OnlyFans, Redfinn, Zillow, Bing, Google, сообщения Reddit, Target, TikTok, Walmart и другие. С помощью API Web Crawler вы можете легко извлекать структурированные данные с любого веб-сайта, не беспокоясь о блокировках IP-адресов или CAPTCHA.

С помощью веб-сканеров вы можете легко отслеживать цены, отслеживать результаты поисковых систем, пополнять базы данных данными в реальном времени, анализировать тенденции и настроения клиентов, а также автоматизировать сбор данных для искусственного интеллекта, машинного обучения и обучения большим языковым моделям. API-интерфейс веб-сканера Decodo может легко имитировать поведение человека в Интернете и снизить вероятность обнаружения. Действительно, вы можете легко получить данные в форматах HTML, JSON и CSV. API веб-скрапинга, предоставляемый

Вам просто нужно отправить запрос API, и вы легко сможете получить необходимые вам данные. Вы не платите за неудачные запросы, а только за успешно собранные запросы данных. Каждый пакет гарантирует геолокацию, управление прокси-серверами, обход антисканеров, среду тестирования API и предварительно созданные сканеры.

особенность

Цена

3. Nimbleway

Nimbleway — еще один надежный поставщик, предоставляющий первоклассные API-сервисы API для парсинга веб-страниц с использованием искусственного интеллекта. Вы можете использовать его для сбора или извлечения данных из любого поддерживаемого доменного имени. Кроме того, вы можете наслаждаться беспрепятственным сканированием, не выходя из Nimble AI Browser, легко собирая данные через REST API без какой-либо инфраструктуры.

Веб-API управляет всем процессом сбора данных: вы просто отправляете вызов API, содержащий целевой URL-адрес, и ждете, пока данные вернутся. Эти API-интерфейсы сканирования можно использовать во многих областях, таких как платформы электронной коммерции, социальные сети и туристические веб-сайты. Более того, вы можете легко настроить различные параметры, такие как географическое положение и метод анализа по URL-адресу.

особенность

Цена

4. Scraper API

ScraperAPI предназначен для сбора данных с различных общедоступных веб-сайтов. Более 10 000 компаний, ориентированных на данные, выбирают ScraperAPI для удовлетворения своих разнообразных потребностей, поэтому вы можете без проблем собирать любые данные с веб-сайта. Будь то Google, Walmart, eBay или Redfin, вы можете легко получить данные. Используя ScraperAPI, вы получаете чистые, высококачественные данные, которые значительно повышают эффективность рабочего процесса.

Его функция конвейера данных позволяет создавать и планировать полноценные проекты сканеров без написания кода. Полученные очищенные данные можно легко использовать для обучения моделей искусственного интеллекта или машинного обучения. С помощью конечной точки структурированных данных необработанный HTML также можно преобразовать в формат JSON или CSV. При получении данных из поддерживаемых доменных имен вероятность успеха достигает 99%.

соответствуют этике, законам и правилам. Поддерживает различные способы оплаты, такие как MasterCard, PayPal, American Express, банковский перевод и Visa. Услуги охватывают электронную коммерцию, финансы, исследования рынка, SEO-оптимизацию, машинное обучение, искусственный интеллект, туризм, агрегирование данных об отелях и подборе персонала и другие отрасли. В дополнение к базовому API сканера вы также можете использовать дополнительные сервисы, такие как конвейеры данных, асинхронные сервисы сканера, структурированную обработку данных и крупномасштабный сбор данных.

особенность

Цена

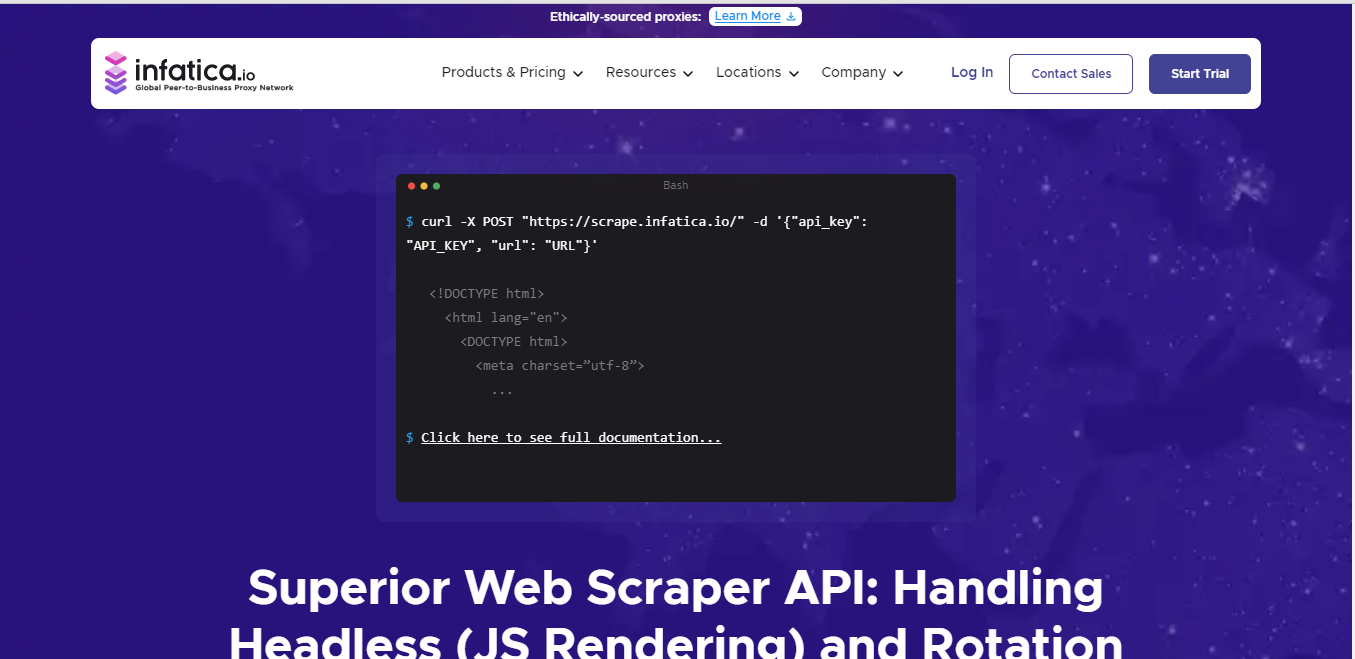

5. Infatica

Infatica, является идеальным решением для сбора обучающих данных машинного обучения (ML) и искусственного интеллекта (AI). Этот API может автоматически выполнять задачи по сбору данных без ручных операций и извлекать данные с веб-сайтов в указанном вами формате, полностью обходя различные ограничения доступа. Сочетание эффективного API сканирования и прокси-сервисов сделает весь процесс сбора данных проще и удобнее.

В реальном использовании вы испытаете чрезвычайно высокую скорость отклика, сверхвысокую вероятность успеха, максимальное время безотказной работы и оптимальную производительность. Используя API сканирования с резидентной прокси-сетью, запросы сканера будут имитировать поведение человека, эффективно избегая таких проблем, как запрет IP-адресов или перехват кода проверки.

В конечном итоге вы получите все необходимые данные в режиме реального времени, не беспокоясь. Уникальное преимущество Infatica заключается в том, что в дополнение к API-интерфейсам сканирования она также предоставляет миллионы прокси-IP-ресурсов, поддержку нескольких регионов, мощную инфраструктуру и множество вариантов бесплатных и платных планов обслуживания.

особенность

Цена

6. Oxylabs

Oxylabs предоставляет надежные услуги сканирования веб-страниц, поддерживая сбор данных из поисковых систем, платформ электронной коммерции, Google, Amazon и других каналов. Вы можете легко определить логику синтаксического анализа, используя селекторы XPath или CSS.

Могут быть получены данные, подходящие для различных целей, таких как электронная коммерция, сетевая безопасность, защита бренда, мониторинг результатов поиска, корпоративная информация, развлечения, туризм и отели и т. д. Поддерживаемые цели сканирования включают Adidas, Alibaba, Amazon, AliExpress, eBay, Chevrolet, Best Buy, Craigslist и другие платформы.

Features

Pricing

7. Scraping Bee

API веб-скрапинга ScrapingBee позволяет легко извлекать данные с помощью технологии искусственного интеллекта. Он может автоматически обрабатывать автономные браузеры, менять IP-адреса прокси-серверов и обеспечивать бесперебойный сбор данных. Платформа искусственного интеллекта может разумно идентифицировать описанные требования к данным и возвращать результаты в формате структурированных данных.

С помощью этой платформы искусственного интеллекта вы можете легко получить полную подробную информацию на веб-странице, чтобы обеспечить точность данных. Поддерживает парсинг веб-страниц с использованием нескольких языков программирования, таких как PHP, Java, Ruby, NodeJS, R, C#, C++, Elixir, Perl, Rust и Go. Кроме того, ScrapingBee взимает плату только за успешные результаты парсинга.

особенность

Pricing

8. Apify

Apify — это универсальная платформа, которая позволяет пользователям легко создавать, развертывать и публиковать веб-сканеры, агенты искусственного интеллекта и инструменты автоматизации. Данные можно получить с различных платформ, таких как Tiptop, Google Maps, Instagram, Amazon и т. д. Поддерживаемые отрасли включают социальные сети, искусственный интеллект, агентства, генерацию потенциальных клиентов, электронную коммерцию, инструменты SEO, набор персонала, сервер MCP, новости, недвижимость, инструменты разработчика, путешествия, видео, автоматизацию, интеграцию, открытый исходный код и т. д.

Кроме того, вы можете легко создавать актеров сканера, используя шаблоны кода и подробные руководства, и даже получить помощь экспертов. Это универсальная платформа, которая позволяет даже создавать и настраивать серверы MCP.

Веб-искатель можно настроить и запустить вручную через пользовательский интерфейс или программно с помощью API. Извлеченные данные сохраняются в наборе данных и могут быть экспортированы в различные форматы, такие как JSON, XML или CSV.

особенность

Цена

9. Zyte

Интеллектуальный API Zyte может эффективно идентифицировать и обходить механизм защиты от сканирования, собирая для вас высококачественные данные для машинного обучения и обучения искусственному интеллекту. Будучи надежной платформой с 14-летним опытом работы в отрасли, API сбора данных Zyte позволяет легко получать точные данные о продуктах и ценах с крупных веб-сайтов электронной коммерции.

Учитывая, что приложениям искусственного интеллекта и машинного обучения требуются огромные объемы высококачественных данных, использование API Zyte Collection обеспечивает чрезвычайно быстрое получение необходимой информации. Платформа охватывает сбор данных в различных отраслях, таких как новости и информация, недвижимость и коммерческие площадки, поэтому вам не нужно беспокоиться об источниках данных.

Благодаря простому и удобному в использовании веб-интерфейсу Scrapy Cloud и интерфейсу API вы можете легко запускать, отслеживать и управлять сканерами Scrapy. Платформа Zyte предоставляет множество инструментов, которые значительно повысят эффективность сбора данных.

особенность

Цена

Итоги

Эти надежные API-интерфейсы веб-скрапинга идеально подходят для получения пользователями данных для обучения моделей AI/ML. Если вы не уверены, какую платформу выбрать, 9 поставщиков услуг, рекомендованных в этой статье, заслуживают доверия и определенно могут удовлетворить ваши потребности.

Некоторые платформы также предоставляют готовые наборы данных, которые можно использовать непосредственно для обучения модели. Он также поддерживает экспорт нескольких форматов данных, таких как CSV, XLSX, JSON и т. д., гарантируя, что вы сможете без проблем получать точные данные для обучения модели!