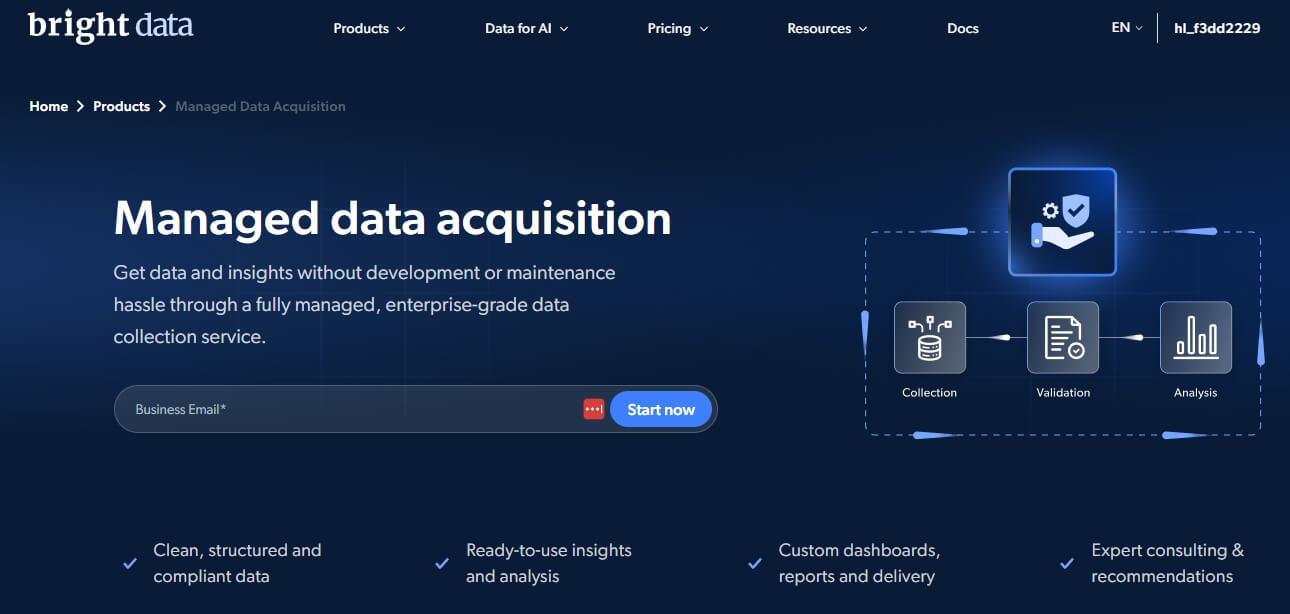

さらに、多くのベンダーが製品ポートフォリオを拡張し、AI支援データ処理、法規制コンプライアンスを確実にするマネージドサービス、プロアクティブなサポート体制などの新機能を提供しています。本稿では、エンタープライズ向けAIデータパイプラインソリューションを深掘り分析し、とりわけ Bright Data に焦点を当てます——包括的なマネージドサービス、強力なデータ収集インフラ、そしてコンプライアンスとセキュリティへの揺るぎないコミットメントで知られるソリューションです。

AIデータパイプラインとは?

AIデータパイプラインはエンドツーエンドのワークフローです。生データを取り込み、機械学習モデルが学習できる表現へ変換し、モデルを学習または微調整し、性能を評価し、本番環境へデプロイ——同時にデータとモデル品質を継続監視します。従来の ETL/ELT パイプラインが主にデータをDWHやBI層へ移すことに注力するのに対し、AIパイプラインはデータ・コード・モデルのバージョン管理、ソースデータのトレーサビリティ、再現可能な実験、分散学習、オンライン/オフラインの特徴量ストア、そしてドリフトや性能低下を契機とした自動再学習も扱う必要があります。

AIパイプライン vs 従来のデータパイプライン

従来型パイプラインは生データを取り込み、SQLベースのクレンジングと集計を実行し、その結果をダッシュボード用にデータウェアハウスへロードする。ジョブ完了後は、次のバッチまで再起動しない。

AIパイプラインは同じように立ち上がりますが、直ちに各データセット、特徴量、モデル構成要素をバージョン管理します。GPU加速の特徴量エンジニアリングを実行し、分散学習を起動し、公平性と精度の閾値に基づいて評価し、本番規模で提供します。本番予測はリアルタイムにフィードバックされ、ドリフト検知時に自動再学習がトリガーされるため、パイプラインは終了するのではなく継続的に学習します。

| 次元 | 従来のデータパイプライン | AIデータパイプライン |

|---|---|---|

| 主な目的 | レポートとダッシュボード向けに、分析に使えるクリーンなデータを提供 | 高品質な特徴量を提供し、モデルを継続的に最適化 |

| エンドユーザー | ビジネスアナリスト、BIツール | データサイエンティスト、機械学習エンジニア、推論サービス |

| データ粒度 | 集計、匿名化、過去データ | 生または準生のイベント、時系列、画像、音声 |

| 変換ロジック | SQL、決定論的ルール | 特徴量エンジニアリング:統計変換、埋め込み、データ拡張 |

| 計算モード | バッチ ETL/ELT; 必要に応じてマイクロバッチ | バッチ処理 + ストリーム処理 + GPU/TPU のトレーニングと推論 |

| ガバナンスの重点 | データ品質、GDPR準拠 | データ品質 + モデルの公平性、説明可能性、ソースデータ、モデルレジストリ |

| バージョン管理 | データセットスナップショット | データ、コード、ハイパーパラメータ、モデル成果物 |

| フィードバックループ | 手動QAと定期リロード | 自動ドリフト検知、再学習、A/Bテスト、シャドーデプロイ |

| 代表的なツール | Airflow、dbt、Snowflake | Kubeflow、MLflow、Vertex AI、Feast、Ray、TFX |

1. Bright Data Managed Service

Bright Data のマネージドサービスは、公開Webをクリーンで構造化され、コンプライアンスに準拠したデータセットへ変換する、フルアウトソース型のエンタープライズデータ収集ソリューションです。エンジニアリング投資は不要です。専任プロジェクトマネージャーがまずデータソース、主要指標、納品フォーマットを確定し、その後 Bright Data は 195カ国をカバーし 1.5億超の実ユーザーIPを擁するグローバルプロキシネットワークで大規模な自動抽出を実現します。内蔵の重複排除・検証・強化パイプラインが分析に直結するデータテーブルを生成し、リアルタイムダッシュボードと専門家レポートが生レコードを実行可能な洞察へ変換します。数千行から数十億行まで弾力的にスケールし、99.99% の可用性を維持、GDPR、CCPA、および各サイトポリシーを全面遵守します。

2. Rivery

Rivery はノーコードのクラウドネイティブAIデータパイプラインプラットフォームで、生成AIおよび RAG アプリへ高品質データをリアルタイムに供給するために設計されています。わずか数分で、200+ のマネージドコネクタが、データベース、CRM、マーケティングスイート、API などの構造化/非構造化ソースを Snowflake、BigQuery、または任意のベクターストアへ同期します。Push-down SQL とインライン Python 変換がクレンジング、チャンク分割、埋め込み生成を担い、Snowflake Cortex や Vertex AI などのベクター宛先にミリ秒単位でベクトルを格納して検索に供します。ビジュアルなオーケストレーション層は上流データが着地した瞬間に GenAI タスクをトリガーし、Rivery Copilot は必要に応じて新コネクタやカスタムロジックを自動生成して、数日のエンジニアリング時間を削減します。

3. Snowflake

Snowflake のAIデータパイプラインは、ゼロ運用のエンドツーエンド環境として、データを「生の状態」から直接「AI対応」へ変換し、インフラ調整を一切不要にします。エンジニアは構造化/半構造化/非構造化の任意のソース——バッチでもストリームでも——を Apache Iceberg ベースのオープンなレイクハウスに取り込み、その後 SQL、dbt プロジェクト、Snowpark Python、または pandas 互換の Modin で変換できます。内蔵の Cortex LLM と Document AI が、埋め込み・分類・要約・翻訳をその場で実行し、下流のエージェントやアプリの RAG フローへリアルタイム注入します。Git ネイティブな DevOps、可観測ビュー、従量課金の弾力的コンピュートにより、データSLAを確保しつつ、典型的な Spark コストを 50% 以上削減できます。

4. DataBahn

DataBahn は、AIネイティブなデータパイプライン管理プラットフォームを提供し、テレメトリのライフサイクル全体——任意のソースから任意の宛先まで——を、ガバナンスされ洞察に富む連続ストリームへ変換します。Smart Edge 層がエージェントレス収集とエッジ分析を担い、Highway がAI駆動のフィルタリング、スキーマドリフト管理、コスト最適化を実行します。「箱入りAIデータエンジニア」Cruz がパイプラインを自律的に解析・リッチ化・監視し、手動チューニングから解放します。すべてのデータは最終的に Reef——状況コンテキストのグラフデータベース——へ集約され、多ソースイベントを関連付けつつAI対応状態を維持します。500+ のプラグ&プレイ統合(クラウド、オンプレ、IoT/OT を網羅)により、DataBahn はリアルタイム可視性を実現し、SIEM/ストレージコストを大幅に削減(顧客は年 25〜35 万ドル節約)、イン/アウトのトラフィック料金も不要、さらにノーコードUIで非技術者でも数分で使い始められます。

5. Google Cloud Dataflow

Google Cloud Dataflow はフルマネージドのストリーミング/バッチ処理プラットフォームで、リアルタイムデータを即座に AI 対応のインサイトへ変換します。オープンソースの Apache Beam を基盤に、Pub/Sub、Kafka、CDC、クリックストリーム、IoT イベントを取り込み、GPU 加速の MLTransform と RunInference により Vertex AI、Gemini、Gemma などのモデルでストリームをリッチ化します。サーバー管理は不要です。自動スケーリングは 0〜4,000 のワーカーノードまで弾力的に拡張し、PB 級データを処理します。Dataflow 診断コンソールはボトルネックを精密に特定し、データをサンプリングしてコストを予測します。事前構築テンプレートと Vertex AI Notebook により、チームは数分で安全・低遅延の ETL、RAG、生成 AI パイプラインを立ち上げ、結果を BigQuery、Cloud Storage、または下流アプリへリアルタイムに書き込み、パーソナライズ体験、不正検知、脅威対応に活用できます。

6. VAST

VAST Data は、分断されたストレージ階層を単一のAIファーストなオペレーティングシステムに置き換え、データを生取り込みから本番学習・推論まで移動不要で扱えるようにします。プラットフォームは EB 級のオールフラッシュアーキテクチャを基盤に、NFS、SMB、S3 といったマルチプロトコル、または GPU-direct 経路で構造化/非構造化データストリームを取り込み、データベース内でリアルタイムのクレンジング、量子化、埋め込み、RAG 強化を実行します。グローバル名前空間に、ゼロコピーのスナップショットと不変のバージョン管理を組み合わせ、厳格な QoS とゼロトラスト分離を保ちながら、数千テナントが同一の論理プールを共有可能です。最終的に統合パイプラインとして、レイテンシをマイクロ秒級まで低減し、GPU への供給を継続、さらにシステム間の重複コピー排除で TCO を大幅に削減します。

7. Fivetran Automated Data Movement

Fivetran は、フルマネージドでエンタープライズ級のデータ流通バックボーンを提供し、700+ の SaaS、データベース、ERP、ファイルソースを数分で分析・AI向けの高価値資産へ変換します。ノーコードコネクタ、自動スキーマドリフト対応、内蔵の変更データキャプチャにより、生データは取り込まれ、標準化され、PB級規模でクラウドDWH/レイク/ベクターストアへストリーミング書き込みされます。ハイブリッド展開により、機密ワークロードをオンプレに保持しつつ、同一パイプラインを再利用可能——SOC 2/ISO 27001/GDPR/HIPAA の認証済みです。エンジニアリング負担を取り除くことで、Fivetran はリアルタイムダッシュボード、機械学習特徴量、生成AIアプリの洞察までの時間を大幅に短縮します。

8. Azure Data Factory

Azure Data Factory (ADF) は、Microsoft のフルマネージド/サーバーレスなデータ統合サービスで、オンプレ、SaaS、クラウドのデータを単一のAI対応パイプラインに統合します。ドラッグ&ドロップのキャンバスや Git 駆動の CI/CD ワークフローにより、市民統合者からプロ開発者まで、ETL/ELT プロセスを設計可能——90+ の内蔵・メンテ不要コネクタで SAP、Salesforce、Cosmos DB、REST API などを取り込みます。マネージド Apache Spark エンジンが変換コードを自動生成・最適化し、意図駆動のマッピングでスキーマ整合を加速します。パイプラインはクレンジング/リッチ化したデータを Azure Synapse Analytics、Azure ML、または AI サービスへ直接投入し、リアルタイムのビジネス洞察とモデル学習を実現——全工程が Microsoft のエンタープライズ級セキュリティと 100+ のコンプライアンス認証で保護されます。

9. AWS Glue

AWS Glue はフルマネージドかつサーバーレスのデータ統合サービスで、AI パイプラインのあらゆる工程——生データの取り込みからモデル対応データセットまで——を、インフラの事前用意やチューニングなしで加速します。コネクタは AWS、オンプレ、サードパーティの 100+ ソースのメタデータを自動検出・カタログ化します。Glue Studio のビジュアル ETL キャンバスや対話型 Notebook で、エンジニアは Apache Spark または Ray を用いて GB から PB までオンデマンドにスケールするパイプラインを設計できます。内蔵の生成 AI アシスタントが PySpark コードを自動生成し、スキーマ進化戦略を提案、ジョブ障害の根因修復まで支援して、開発サイクルを数日から数分へ短縮します。新世代の Amazon SageMaker と深く統合することで、Glue はクレンジング/リッチ化したデータを特徴量ストア、ベクターデータベース、学習クラスターへ直接ストリーミング注入し、リアルタイム実験と継続的再学習を実現します。

10. Apache Airflow

Apache Airflow はオープンソースのオーケストレーションエンジンで、Python コードをそのまま本番品質の AI データパイプラインに変換します。ワークフローは純粋な Python の DAG で定義され、動的タスク生成、ループ、分岐をサポートし、特徴量抽出、モデル学習、ハイパーパラメータ調整、バッチ推論といった複雑な機械学習ライフサイクルを容易にカバーします。メッセージキュー基盤のバックエンドによりスケジューラは水平方向に拡張でき、数千の並列 Worker まで対応します。モダンな Web UI でタスクログ、リトライ、SLA をリアルタイム表示します。豊富な Operator エコシステムは Google Cloud、AWS、Azure、Snowflake、Spark、Kubernetes などへ箱から出して接続でき、取り込み、変換、モデルデプロイ、監視の各ステップをシームレスに連結します。すべてがコードであるため、チームは通常のソフトウェア同様にパイプラインをバージョン管理・テスト・再利用でき、AI サービスの実験と継続的デリバリーを加速します。

11. Estuary

Estuary Flow はクラウドネイティブのリアルタイムデータ統合プラットフォームで、AI と検索拡張生成(RAG)アプリへ最新で統一されたデータを継続的に届けるために構築されています。低遅延の CDC とストリーム処理により、Salesforce、HubSpot、Postgres、Kafka などをリアルタイム同期し、宣言的な SQL/TypeScript 変換で即座にクレンジング、リッチ化、スキーマ進化を行います。結果はサブ秒のウィンドウで Pinecone、Snowflake などのベクターストアへ直接マテリアライズされ、モデルが常に最新コンテキストを検索できるようにします。内蔵のバックプレッシャー処理と exactly-once セマンティクスにより、Flow は MB 級から TB 級まで運用負担なく弾力的にスケールし、データサイエンティストは基盤工学ではなくモデル精度向上に集中できます。

12. Snowplow

Snowplow は、未加工の顧客インタラクションをAI対応データセットへ変換するために設計された、リアルタイムで高スケールな行動データパイプラインを提供します。35+ のファーストパーティ・トラッカーと Webhook により、Web、モバイル、IoT、ゲーム、AIエージェントから粒度の高いイベントを捕捉し、各イベントに 130+ のコンテキスト属性を自動付与、送信中にスキーマ検証も実行します。ストリーム内リッチ化——PIIの仮名化、ボット検知、チャネルアトリビューション——は JavaScript、SQL、API でリアルタイムに実行でき、GDPR、CCPA、HIPAA に準拠しつつ低遅延を維持します。統一イベントテーブルは Snowflake、Databricks、BigQuery、S3、または Kafka/Pub/Sub などのストリーミング受け口へ直接書き込まれ、マルチテーブル結合を不要にして下流のML/RAGワークロードを加速します。企業は Snowplow のホステッド版、または AWS/GCP/Azure 上のプライベート・マネージドクラウドへのデプロイを選べ、エンタープライズ級のセキュリティと SLA を享受できます。

結論

エンタープライズ級のAIデータパイプラインは、AI駆動オペレーションの潜在力を最大限に引き出すうえで不可欠です。堅牢なパイプラインは、データが適時かつ安全に流れることを保証するだけでなく、実行可能な洞察を提供してビジネス革新を推進します。先進ソリューションを比較評価すると、数多くのプラットフォームがデータ統合、支援能力、スケーラビリティの面でそれぞれ強みを持つ一方で、

多くのソリューションが特定領域で優れた性能を示す一方、Bright Data のマネージドサービスは——強力な統合能力、プロアクティブなサポート、包括的なセキュリティフレームワークにより——企業が高効率で信頼性が高く将来志向のAIデータパイプラインを構築するための第一選択となります。